Pronostici 1X2 con Algoritmo: Strategie per il Mercato Più Difficile

Il mercato 1X2 è il mercato più giocato, più analizzato e, per lo scommettitore algoritmico, più difficile da battere. Tre esiti possibili significano che i bookmaker devono dividere il margine tra tre quote anziché due, il che in teoria lascia più spazio per le inefficienze. In pratica, il mercato 1X2 è anche il più liquido — il volume di scommesse è enorme — e la liquidità attira scommettitori informati i cui flussi rendono le quote sempre più efficienti.

Chi vuole affrontare il mercato 1X2 con un approccio algoritmico deve accettare due realtà. La prima è che l’accuratezza media dei modelli sul 1X2 è strutturalmente limitata: anche i migliori raramente superano il 55% su campioni ampi. La seconda è che l’accuratezza, da sola, non determina la profittabilità — ciò che conta è trovare gli esiti dove il modello è più preciso del bookmaker, non dove è preciso in assoluto.

Il problema del pareggio

Il pareggio è il nemico di ogni modello previsionale applicato al calcio. Nella Serie A, circa il 25-28% delle partite finisce in pareggio — una percentuale significativa che nessun modello riesce a prevedere con precisione costante. La ragione è che il pareggio è un risultato residuale: non è la conseguenza di una dinamica specifica ma l’assenza di una vittoria per entrambe le squadre. Due squadre ugualmente forti non producono necessariamente più pareggi — possono produrne di più o di meno a seconda dello stile di gioco, della mentalità e di fattori contestuali che sfuggono ai modelli statistici.

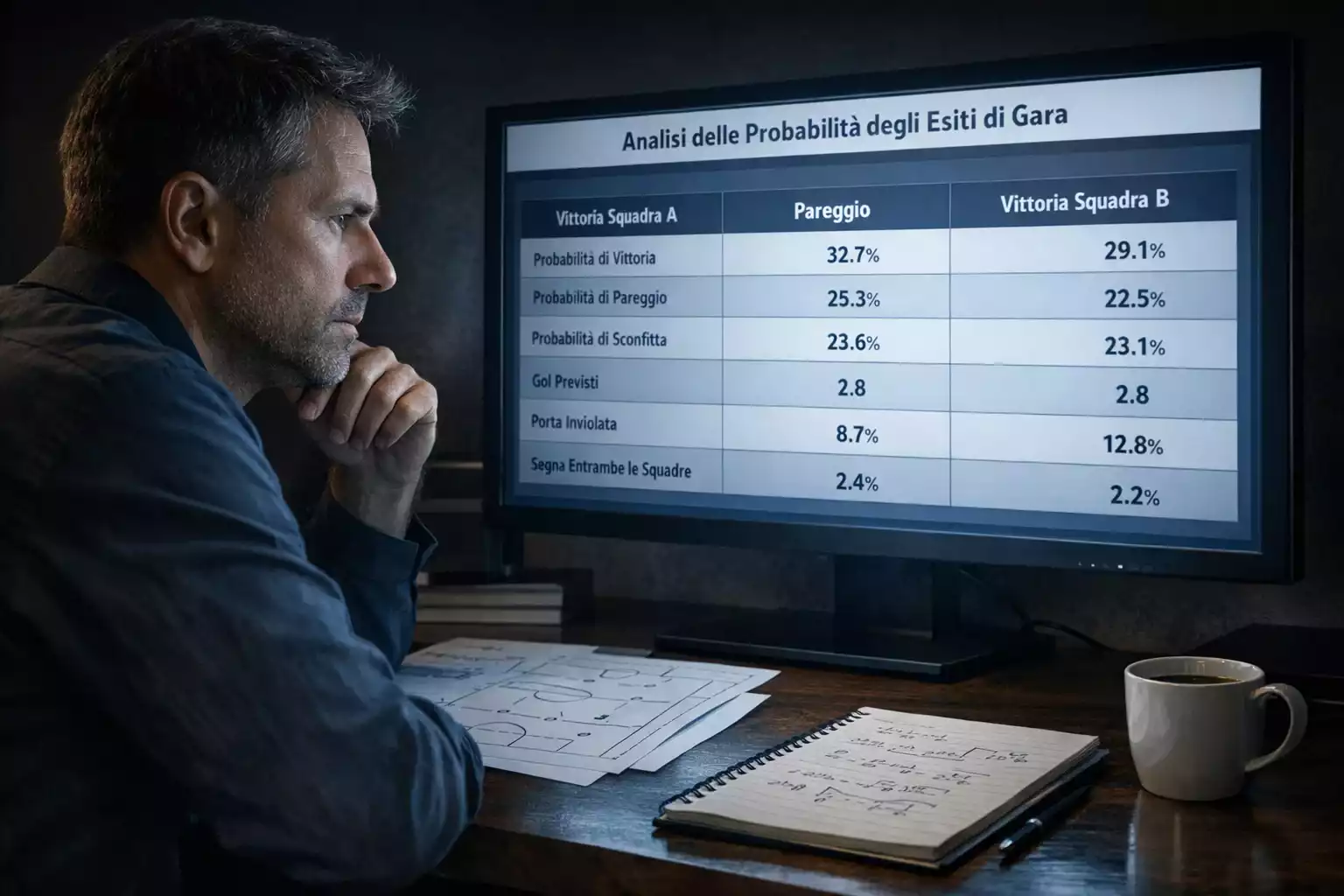

Il modello di Poisson calcola la probabilità del pareggio come la somma della diagonale della matrice (0-0, 1-1, 2-2, eccetera). Il problema è che questa stima tende a essere instabile: piccole variazioni nei lambda spostano significativamente la probabilità del pareggio, perché i punteggi sulla diagonale occupano una zona ristretta della matrice. Un lambda casa di 1,5 vs 1,7 può cambiare la probabilità del pareggio di 3-4 punti percentuali — un margine che in termini di value bet è enorme.

Per questa ragione, molti scommettitori algoritmici evitano di scommettere sul pareggio o lo fanno solo con soglie di EV molto alte (superiori al 5-7%). La volatilità della stima rende le value bet apparenti sul pareggio più rischiose delle value bet sulla vittoria casa o trasferta, dove le probabilità sono più stabili.

Un approccio alternativo è il mercato double chance (1X, X2, 12), che elimina il pareggio dall’equazione combinandolo con una delle vittorie. Se il tuo modello dice che il Napoli ha il 52% di probabilità di vincere e il pareggio ha il 28%, la probabilità del 1X è dell’80% — una stima molto più stabile e meno sensibile agli errori nei lambda. Le quote del double chance sono naturalmente più basse, ma il trade-off tra stabilità e rendimento può essere favorevole.

Dove trovare valore nel mercato 1X2

Le inefficienze nel mercato 1X2 non sono distribuite uniformemente. Esistono pattern documentati che i modelli algoritmici possono sfruttare.

Il primo è il home underdog bias. I bookmaker tendono a sottovalutare leggermente le squadre di casa quando sono sfavorite — la quota della vittoria casalinga per una squadra data per sfavorita è spesso più alta di quanto le probabilità reali giustifichino. Questo bias è più marcato nelle partite tra squadre di metà classifica, dove la differenza di qualità è piccola e il vantaggio casalingo pesa relativamente di più.

Il secondo pattern è il favorite-longshot bias, uno dei fenomeni più studiati nella letteratura del betting. I grandi favoriti (quote sotto 1,30) tendono a essere leggermente sovrastimati — la loro probabilità reale è un po’ inferiore a quella implicita nella quota. Al contrario, i grandi sfavoriti (quote sopra 5,00) tendono a essere sottostimati — vincono un po’ più spesso di quanto la quota suggerisca. Questo bias è attribuito al comportamento degli scommettitori ricreazionali, che preferiscono puntare sulle favorite a bassa quota piuttosto che sugli underdog rischiosi.

Il terzo pattern riguarda la forma recente. I bookmaker incorporano la forma recente nelle quote, ma tendono a sovrapesarla per le squadre in serie positiva e sottopesarla per le squadre in serie negativa. Se una squadra ha perso le ultime cinque partite, il mercato la penalizza oltre il ragionevole — e il tuo modello, che bilancia la forma recente con la qualità complessiva della squadra, può trovare valore sulla sua vittoria.

Combinare più modelli per il mercato 1X2

Nessun singolo modello eccelle su tutti gli aspetti del mercato 1X2. Il Poisson è buono per le partite con differenze di qualità marcate ma debole sui pareggi. L’Elo cattura la forma dinamica ma non distingue tra attacco e difesa. Il machine learning può integrare molte variabili ma rischia l’overfitting su campioni piccoli. La strategia ottimale è combinare le previsioni di più modelli in un ensemble.

L’approccio più semplice è la media ponderata delle probabilità. Se il tuo Poisson stima la vittoria del Napoli al 55%, il tuo Elo al 52% e il tuo Random Forest al 58%, la media semplice è 55%. Se hai evidenza dal backtesting che un modello è più accurato degli altri su certe categorie di partite, puoi usare pesi diversi — per esempio, dare peso maggiore al Random Forest per le partite tra squadre di vertice e peso maggiore al Poisson per le partite tra squadre di bassa classifica.

Un approccio più sofisticato è il model stacking: addestrare un meta-modello che prende come input le previsioni dei modelli individuali e produce una previsione finale ottimizzata. Il meta-modello impara a pesare i modelli in base alla loro affidabilità storica per diverse tipologie di partite. L’implementazione richiede un dataset di previsioni passate di tutti i modelli e i risultati effettivi — in pratica, un backtesting parallelo di tutti i modelli su diverse stagioni.

L’ensemble non è una garanzia di miglioramento. Se i modelli individuali sono tutti basati sugli stessi dati e usano approcci simili, combinarli aggiunge poco. Il valore dell’ensemble emerge quando i modelli sono diversificati — usano dati diversi, logiche diverse, assunzioni diverse — perché gli errori di un modello tendono a essere compensati dagli altri. La diversificazione dei modelli segue la stessa logica della diversificazione degli investimenti: riduce il rischio senza necessariamente ridurre il rendimento.

La calibrazione: il test che non puoi saltare

Un modello che prevede il 60% per il Napoli non è utile se, storicamente, le partite che il modello quotava al 60% sono state vinte solo il 50% delle volte. Il modello è sistematicamente ottimista, e le sue previsioni non possono essere usate direttamente per calcolare l’EV. La calibrazione misura esattamente questo: la corrispondenza tra le probabilità stimate e le frequenze osservate.

Il test di calibrazione più semplice è raggruppare le previsioni in intervalli di probabilità (45-50%, 50-55%, 55-60%, eccetera) e verificare che la percentuale di vittorie osservate in ogni intervallo corrisponda alla probabilità media dell’intervallo. Se le partite con probabilità stimata del 55% vengono vinte il 54-56% delle volte, il modello è ben calibrato in quel range. Se vengono vinte solo il 48% delle volte, il modello è troppo ottimista e necessita di aggiustamento.

Il diagramma di calibrazione (reliability diagram) è la visualizzazione grafica di questo test: sull’asse x le probabilità stimate, sull’asse y le frequenze osservate. Un modello perfettamente calibrato produce punti sulla diagonale. Deviazioni dalla diagonale indicano le zone dove il modello è troppo ottimista (punti sotto la diagonale) o troppo pessimista (punti sopra).

La calibrazione è più importante dell’accuratezza per il betting, perché il calcolo dell’EV dipende dalla probabilità stimata, non dalla percentuale di previsioni corrette. Un modello che è corretto il 52% delle volte ma ben calibrato ti permette di calcolare l’EV con fiducia. Un modello corretto il 55% delle volte ma mal calibrato ti farà calcolare EV sbagliati e scommettere sulle partite sbagliate.

Il mercato 1X2 non perdona l’approssimazione

C’è una ragione per cui molti scommettitori algoritmici di successo si concentrano sull’over/under o sull’handicap asiatico anziché sul 1X2: il mercato 1X2 è il più efficiente e il meno tollerante verso gli errori di modellazione. I margini di errore ammissibili sono più stretti, le quote sono più competitive e la volatilità intrinseca dei risultati — con il pareggio che funziona da wildcard imprevedibile — rende la strada verso la profittabilità più ripida.

Ma è anche il mercato con il volume più alto, il che significa che le value bet, quando le trovi, possono essere sfruttate con stake significativi senza problemi di liquidità. E per chi ha un modello realmente superiore — calibrato, diversificato, testato su più stagioni — il mercato 1X2 offre più opportunità in termini assoluti di qualsiasi altro mercato.

La strategia vincente nel 1X2 non è cercare il modello perfetto — non esiste — ma costruire un processo disciplinato: modelli multipli, calibrazione rigorosa, soglie di EV conservative e pazienza. Il mercato 1X2 non premia chi cerca scorciatoie. Premia chi accetta che un’accuratezza del 53% è un risultato eccellente, che il 47% delle scommesse perderà e che il profitto si manifesta solo nella somma di centinaia di decisioni razionali.