Machine Learning per Betting: Guide ai Modelli

Il machine learning è diventato la parola magica del betting algoritmico. Ogni app, ogni servizio di pronostici, ogni guru su YouTube dichiara di usare “intelligenza artificiale” e “algoritmi di apprendimento automatico” per generare previsioni. Ma dietro il marketing, cosa c’è davvero? E soprattutto, il machine learning funziona meglio dei modelli statistici classici come il Poisson o il Dixon-Coles per le scommesse calcistiche?

La risposta, come spesso accade nelle cose serie, è: dipende. Questa guida esamina i principali modelli di machine learning applicati ai pronostici calcistici, con i loro punti di forza e di debolezza reali — non quelli dichiarati nelle brochure.

La tecnologia si evolve, e così il nostro Algoritmo Scommesse Calcio ad alte prestazioni.

Random Forest: il modello che funziona quasi sempre

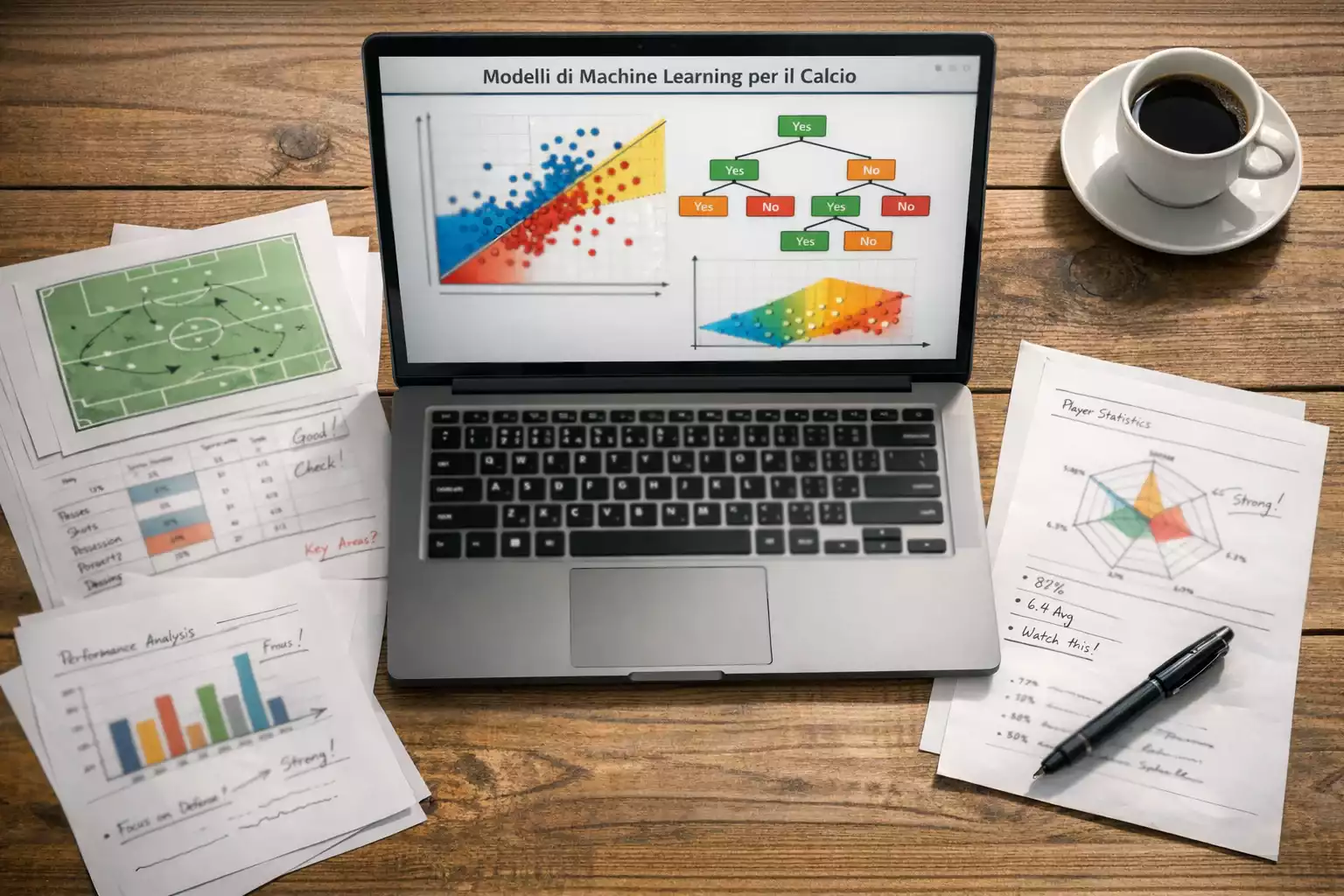

Il Random Forest è probabilmente il modello di machine learning più usato nelle scommesse calcistiche, e per buone ragioni. Si tratta di un insieme (ensemble) di alberi decisionali, ciascuno addestrato su un sottoinsieme casuale dei dati e delle variabili. La previsione finale è la media (o il voto di maggioranza) delle previsioni di tutti gli alberi. Questa struttura rende il modello robusto, difficile da sovraallenare (overfitting) e relativamente facile da configurare.

Per i pronostici calcistici, un Random Forest tipico prende come input una serie di feature per ogni partita — forma recente delle due squadre, medie gol, xG, posizione in classifica, giorni di riposo, vantaggio casalingo, head-to-head — e predice l’esito della partita (vittoria casa, pareggio, vittoria trasferta) oppure una probabilità continua per ciascun esito.

Il vantaggio principale del Random Forest è la capacità di gestire relazioni non lineari tra le variabili senza che tu debba specificarle esplicitamente. Se il vantaggio casalingo è più marcato per le squadre in fondo alla classifica che per quelle in cima, il Random Forest lo cattura automaticamente, mentre un modello lineare o un Poisson standard lo ignorerebbero. Inoltre, il Random Forest fornisce una misura dell’importanza di ciascuna variabile — puoi scoprire che la forma nelle ultime cinque partite conta più della posizione in classifica, per esempio — il che è utile per capire cosa guida le previsioni.

Il limite è che il Random Forest, come tutti i modelli di ensemble basati su alberi, non eccelle con dataset molto piccoli. Se hai solo una stagione di dati (380 partite di Serie A), il modello non ha abbastanza materiale per apprendere pattern complessi. In questi casi, il Poisson o il Dixon-Coles, che sfruttano una struttura matematica forte con pochi parametri, tendono a essere più affidabili.

Gradient Boosting: potenza e rischio di overfitting

Il Gradient Boosting (nelle sue varianti XGBoost, LightGBM e CatBoost) è l’altro grande protagonista del machine learning applicato al betting. A differenza del Random Forest, dove gli alberi sono indipendenti, nel Gradient Boosting ogni albero viene costruito per correggere gli errori dell’albero precedente. Il risultato è un modello sequenziale che migliora iterativamente, concentrandosi sugli esempi più difficili da prevedere.

XGBoost in particolare è diventato lo standard di fatto nelle competizioni di data science (Kaggle, per intenderci) e molti analisti sportivi lo hanno adottato per i pronostici calcistici. Le sue performance su dataset strutturati — tabelle con righe e colonne, esattamente il formato dei dati calcistici — sono generalmente superiori a quelle del Random Forest, soprattutto quando i dati sono abbondanti e ben curati.

Il rischio principale del Gradient Boosting è l’overfitting — il modello impara troppo bene i dati di addestramento e si adatta al rumore anziché al segnale. Nel contesto delle scommesse calcistiche, dove i dati sono relativamente pochi e il rumore è alto (il calcio è intrinsecamente imprevedibile), questo rischio è concreto. Un XGBoost che raggiunge il 65% di accuratezza sui dati di training ma solo il 50% sui dati di test non è un buon modello — è un modello che ha memorizzato il passato senza imparare nulla di generalizzabile.

Per mitigare l’overfitting, le tecniche standard sono la cross-validation temporale (addestrare sui dati fino alla giornata X e testare sulla giornata X+1, ripetendo per tutta la stagione), la regolarizzazione (penalizzare i modelli troppo complessi) e l’early stopping (fermare l’addestramento quando le performance sui dati di validazione smettono di migliorare). Queste precauzioni non sono opzionali — senza di esse, il Gradient Boosting è uno strumento pericoloso che ti dà una falsa sensazione di precisione.

Support Vector Machine: il modello del matematico

Le Support Vector Machine (SVM) occupano un posto particolare nel panorama del machine learning per le scommesse. Sono modelli eleganti dal punto di vista matematico — cercano l’iperpiano ottimale che separa le classi nello spazio delle feature — ma nella pratica vengono usate meno frequentemente del Random Forest e del Gradient Boosting per i pronostici calcistici.

Il motivo principale è la scalabilità. Le SVM funzionano bene con un numero moderato di feature e di campioni, ma diventano lente e computazionalmente costose quando il dataset cresce. Per un singolo campionato, questo non è un problema. Ma se vuoi addestrare un modello su cinque campionati europei con dieci stagioni di dati e trenta feature per partita, le SVM iniziano a mostrare i loro limiti pratici.

Dove le SVM brillano è nei problemi di classificazione binaria con feature ben separate. Se riduci il problema dei pronostici a una classificazione binaria — per esempio, over vs under 2.5 gol, oppure vittoria casa vs non-vittoria casa — le SVM possono dare risultati competitivi con quelli del Gradient Boosting, soprattutto se le feature sono state ben selezionate e normalizzate. Il kernel RBF (Radial Basis Function) è la scelta più comune per i dati calcistici, perché cattura relazioni non lineari senza richiedere una specifica esplicita della forma funzionale.

Un vantaggio spesso trascurato delle SVM è la regolarizzazione intrinseca. Per costruzione, le SVM cercano il margine massimo tra le classi, il che le rende meno soggette all’overfitting rispetto agli alberi decisionali non regolarizzati. Per chi ha dataset piccoli — una o due stagioni di un singolo campionato — le SVM possono essere una scelta più prudente del Gradient Boosting, che tende a sovraallenarsi su campioni ridotti.

Quale modello scegliere: una guida pratica

La scelta del modello non è una questione di quale sia “il migliore” in astratto, ma di quale sia il più adatto al tuo contesto specifico. Tre variabili determinano la scelta: la quantità di dati disponibili, la tua competenza tecnica e il tipo di mercato su cui scommetti.

Con pochi dati (una stagione, un campionato), i modelli statistici classici — Poisson, Dixon-Coles — sono generalmente superiori al machine learning. Hanno meno parametri da stimare, sfruttano assunzioni strutturali forti e sono meno sensibili al rumore. Il machine learning ha bisogno di volume per esprimere il suo potenziale, e con 380 partite quel volume non c’è.

Con dati medi (tre-cinque stagioni, uno o due campionati), il Random Forest è la scelta più sicura. È robusto, facile da configurare, resistente all’overfitting e fornisce risultati interpretativi. Per la maggior parte degli scommettitori algoritmici, il Random Forest è il punto di equilibrio ottimale tra complessità e utilità.

Con molti dati (dieci o più stagioni, più campionati), il Gradient Boosting (XGBoost o LightGBM) esprime il suo pieno potenziale. Le performance sono generalmente superiori a quelle del Random Forest su dataset grandi, ma richiedono più cura nella configurazione e nella prevenzione dell’overfitting.

Le SVM sono una scelta valida per problemi binari specifici con dataset moderati, ma raramente sono la prima scelta per chi inizia con il machine learning sportivo.

Un punto spesso sottovalutato è che il modello di machine learning non sostituisce la feature engineering — la scelta e la costruzione delle variabili di input. Un Gradient Boosting alimentato con feature scadenti produce risultati scadenti, indipendentemente dalla sofisticazione dell’algoritmo. La differenza tra un buon modello e un modello mediocre sta più nella qualità dei dati e delle feature che nella scelta dell’algoritmo.

Il machine learning non è magia, è contabilità sofisticata

C’è un’illusione pericolosa che il marketing dell’intelligenza artificiale alimenta nel settore delle scommesse: l’idea che un algoritmo sufficientemente avanzato possa “risolvere” il calcio, trovando pattern nascosti che i modelli tradizionali non vedono e generando profitti consistenti.

La realtà è meno cinematografica. Il machine learning applicato al calcio è un esercizio di estrazione marginale di segnale da dati rumorosi. I miglioramenti rispetto ai modelli statistici classici sono dell’ordine di 1-3 punti percentuali di accuratezza — significativi nel lungo periodo se tradotti in scommesse, ma molto lontani dalla certezza. Un Random Forest non “capisce” il calcio più di un modello di Poisson; semplicemente ha più gradi di libertà per adattarsi ai dati, il che è un vantaggio quando i dati sono abbondanti e una trappola quando non lo sono.

Chi usa il machine learning con successo nelle scommesse lo fa con disciplina ingegneristica: dati puliti, feature ragionate, validazione rigorosa, gestione del rischio. Non è glamour, non fa titoli su YouTube, ma funziona. La magia, se esiste, sta nella pazienza di fare le cose per bene.

Genera previsioni matematiche accurate per i pronostici 1×2 con algoritmo.